Layer 2 Switch erklärt

Ein Netzwerkswitch ist ein zentrales Gerät in einem Computernetzwerk, das Datenpakete innerhalb eines lokalen Netzwerks (z. B. LAN) empfängt, verarbeitet und an das bestimmte Zielgerät weiterleitet. Im Gegensatz zu einem Hub, der Datenpakete einfach blind an alle Geräte in einem Netzwerk sendet, ist ein Switch in der Lage, den spezifischen Kommunikationspfad zu bestimmen und Daten effizient zu leiten. Dies geschieht normalerweise auf Basis von MAC-Adressen.

Hauptfunktionen eines Switches:

- Datenweiterleitung:

- Ein Switch verwendet die MAC-Adresse eines Datenpakets, um zu bestimmen, an welchen Port es gesendet werden soll. Dies ist als „Frame Switching“ bekannt.

- Dieses Verhalten verhindert den unnötigen Verkehr auf allen anderen Ports, wodurch Kollisionen minimiert und die Netzwerkleistung verbessert werden.

- Segmentierung:

- Durch das Unterteilen eines Netzwerks in Segmente kann ein Switch den Datenverkehr in jedem Segment isolieren. Das bedeutet, dass ein Problem in einem Segment nicht zwangsläufig alle anderen Segmente beeinflusst.

- Segmentierung kann dazu beitragen, Kollisionen zu verhindern und die Netzwerkeffizienz zu steigern, insbesondere in großen Netzwerken.

- Lernen und Adaptieren:

- Switches haben eine „MAC-Adressentabelle“. Wenn ein Switch ein Datenpaket empfängt, „lernt“ er die MAC-Adresse des sendenden Geräts und fügt sie seiner Tabelle hinzu.

- Bei zukünftigem Datenverkehr verwendet der Switch diese Tabelle, um schnell zu bestimmen, an welchen Port das Paket gesendet werden soll.

Unterschiede zwischen Hubs, Routern und Switches:

- Hubs:

- Einfachste Form eines Netzwerkgeräts.

- Ein Hub sendet Datenpakete blind an alle seine Ports. Es hat keine Intelligenz, um zu entscheiden, welches Gerät das Paket eigentlich empfangen soll.

- Nachteil: In großen Netzwerken können Hubs zu vielen Kollisionen und Netzwerkverzögerungen führen.

- Beispiel: Ein offenes Mikrofon in einem Raum. Alles, was gesagt wird, kann von jedem gehört werden, unabhängig davon, für wen die Nachricht eigentlich bestimmt war.

- Switches:

- Bietet eine intelligentere Methode zur Datenweiterleitung basierend auf MAC-Adressen.

- Kann Datenverkehr segmentieren und den Netzwerkverkehr effizienter gestalten.

- Beispiel: Ein Telefonzentralist, der gezielte Anrufe entgegennimmt und sie an die richtige Person weiterleitet.

- Router:

- Dient als Schnittstelle zwischen zwei oder mehr Netzwerken.

- Bestimmt den besten Weg für Datenpakete, um ihr Ziel zu erreichen.

- Bietet zusätzliche Funktionen wie NAT, DHCP und Firewall-Funktionalität.

- Beispiel: Ein Flughafen, der Flugzeuge (Datenpakete) zu ihrem jeweiligen Ziel lenkt.

Typen von Switches und ihre Anwendungsgebiete

1. Unmanaged Switches (Nicht verwaltete Switches)

Definition: Unmanaged Switches sind Netzwerkgeräte, die es ermöglichen, mehrere Ethernet-Geräte in einem Netzwerk zu verbinden. Diese Switches erfordern keine Konfiguration und beginnen sofort nach dem Anschluss mit dem Betrieb. Sie leiten den Datenverkehr basierend auf den MAC-Adressen der angeschlossenen Geräte weiter.

Hauptmerkmale:

- Keine Benutzeroberfläche oder Konfigurationsmöglichkeiten: Da sie keine Konfiguration benötigen, verfügen Unmanaged Switches über keine Benutzeroberfläche, wie z.B. ein Webinterface oder eine Konsole.

- Standard-Ethernet-Funktionalität: Sie bieten grundlegende Netzwerkfunktionen, um Geräte miteinander zu verbinden und Daten zwischen ihnen weiterzuleiten. Sie unterstützen in der Regel Standard-Ethernet-Protokolle und -Geschwindigkeiten.

Anwendungsgebiete:

- Heimnetzwerke: Für die meisten Haushalte sind die Funktionen eines Unmanaged Switches ausreichend, um Geräte wie Computer, Drucker und Spielekonsolen miteinander zu verbinden.

- Kleine Büros: In Umgebungen, in denen die Netzwerkanforderungen nicht komplex sind und keine speziellen Konfigurationen oder Sicherheitsfeatures benötigt werden, sind Unmanaged Switches oft eine kostengünstige Wahl.

- Einfache Netzwerke: An Orten, an denen keine erweiterten Netzwerkfunktionen erforderlich sind oder wo nur eine einfache Erweiterung des Netzwerks benötigt wird, sind diese Switches ideal.

Unmanaged Switches sind eine ausgezeichnete Wahl für Benutzer, die eine einfache, kostengünstige Lösung zur Erweiterung ihres Netzwerks benötigen, ohne sich mit komplexen Konfigurationen oder Einstellungen auseinandersetzen zu müssen. Es ist jedoch wichtig zu beachten, dass sie nicht die erweiterten Funktionen und Sicherheitsfeatures bieten, die ein managed Switch bieten kann.

2. Managed Switches (Verwaltete Switches)

Definition:

Managed Switches sind Netzwerkgeräte, die Administratoren eine umfassende Kontrolle und Verwaltung über ihr Netzwerk bieten. Im Gegensatz zu Unmanaged Switches verfügen sie über eine Benutzeroberfläche, häufig ein Web-Interface oder eine CLI (Command-Line Interface), durch die eine Vielzahl von erweiterten Funktionen und Konfigurationsmöglichkeiten zugänglich sind.

Hauptmerkmale:

- Unterstützung für VLANs (Virtual Local Area Networks): Ermöglicht die Segmentierung des Netzwerks in kleinere, isolierte Netzwerke, um den Datenverkehr effizienter zu steuern und die Sicherheit zu erhöhen.

- Netzwerküberwachung und -analyse: Bietet Einblicke in den Netzwerkverkehr, hilft bei der Erkennung von Engpässen und ermöglicht die Überwachung der Netzwerkleistung.

- Port- und Verkehrskontrolle: Erlaubt das Ein- oder Ausschalten von Netzwerkports und die Kontrolle des durch sie fließenden Verkehrs.

- Qualitätsservice (QoS) für Datenverkehrspriorisierung: Priorisiert bestimmten Datenverkehr, um sicherzustellen, dass kritische Anwendungen immer die benötigten Ressourcen haben.

- Layer 3 Routing-Funktionen in Multilayer-Switches: Einige Managed Switches können auch Routing-Funktionen auf Layer 3 des OSI-Modells durchführen, was sie zu Multilayer-Switches macht.

Anwendungsgebiete:

Managed Switches sind ideal für Umgebungen, die eine fortgeschrittene Netzwerkkontrolle, Überwachung oder Sicherheit benötigen. Dies umfasst:

- Unternehmensnetzwerke, wo der Datenverkehr effizient gesteuert und überwacht werden muss.

- Große Institutionen mit komplexen Netzwerkanforderungen.

- Datenzentren, die eine optimale Leistung und Sicherheit benötigen.

- Jeder Ort, an dem erweiterte Netzwerkfunktionalität, Überwachung oder Sicherheit erforderlich ist.

3. Smart Switches (oder Halbverwaltete Switches)

Definition:

Smart Switches, manchmal auch als halbverwaltete Switches bezeichnet, stellen eine Brücke zwischen den einfachen Unmanaged Switches und den hochgradig konfigurierbaren Managed Switches dar. Sie bieten eine Reihe von Verwaltungsfunktionen, sind jedoch nicht so feature-reich oder komplex in ihrer Bedienung wie die Managed Switches.

Hauptmerkmale:

- Eingeschränkte Konfigurationsmöglichkeiten: Während sie mehr Funktionalität als Unmanaged Switches bieten, haben sie nicht den vollen Funktionsumfang von Managed Switches.

- Web-basierte Interfaces: Viele Smart Switches bieten ein Web-Interface, das den Zugriff und die Konfiguration erleichtert, ohne dass spezielle Software oder tiefe Netzwerkkenntnisse erforderlich sind.

- Grundlegende VLAN- und QoS-Funktionalität: Sie unterstützen häufig Funktionen wie VLAN zur Segmentierung von Netzwerken und QoS zur Priorisierung des Datenverkehrs, jedoch oft mit weniger Granularität oder Anpassungsmöglichkeiten im Vergleich zu Managed Switches.

Anwendungsgebiete:

Smart Switches sind ideal für:

- Kleinere Unternehmen, die über Grundlagen der Netzwerkverwaltung hinausgehen möchten, ohne jedoch in die Komplexität und den Preis vollständig verwalteter Switches zu investieren.

- Bildungseinrichtungen, die sowohl Benutzerfreundlichkeit als auch ein gewisses Maß an Netzwerkkontrolle benötigen.

- Umgebungen, in denen ein Basissatz von Verwaltungsfunktionen wünschenswert ist, ohne den Bedarf oder das Budget für umfassende Managed Switch-Funktionen.

4. PoE-Switches (Power over Ethernet)

Definition:

PoE-Switches (Power over Ethernet) sind spezielle Netzwerkgeräte, die sowohl Daten als auch elektrischen Strom über ein einziges Ethernet-Kabel an Endgeräte liefern können. Dies vereinfacht die Installation von Geräten, da kein separates Stromkabel benötigt wird, und kann besonders nützlich sein, wenn Steckdosen nicht in unmittelbarer Nähe sind.

Hauptmerkmale:

- Strom- und Datenübertragung über ein Kabel: PoE-Switches kombinieren Netzwerkdaten und Stromversorgung in einem einzigen Ethernet-Kabel, wodurch die Notwendigkeit von zusätzlichen Stromquellen oder -adaptern entfällt.

- Automatische Erkennung von PoE-Geräten: Diese Switches sind intelligent genug, um zu erkennen, welche der angeschlossenen Geräte PoE unterstützen, und versorgen nur diese mit Strom. Das schützt nicht-PoE-Geräte vor möglichen Schäden durch eine unsachgemäße Stromversorgung.

Anwendungsgebiete:

PoE-Switches sind besonders nützlich in Umgebungen, in denen die Installation von separaten Stromquellen unpraktisch oder teuer wäre:

- Überwachungssysteme: IP-Kameras können oft an Orten platziert werden, an denen keine leicht zugängliche Steckdose vorhanden ist.

- Büros mit VoIP-Telefonen: Diese Telefone können über dasselbe Kabel betrieben werden, das sie mit dem Netzwerk verbindet.

- WLAN-Access Points: Vor allem in großen Gebäuden oder im Freien, wo der Zugang zu Steckdosen begrenzt sein kann.

Die Verwendung von PoE-Switches vereinfacht die Netzwerkinfrastruktur und verringert den Verkabelungsaufwand, wodurch sie zu einer beliebten Wahl in vielen modernen Netzwerkumgebungen geworden sind.

Funktionsweise eines Switches

1. Datenübertragung auf Basis von MAC-Adressen

- Erläuterung: Switches leiten Datenpakete, genannt Frames, basierend auf den MAC-Adressen der angeschlossenen Geräte weiter. Die MAC-Adresse ist eine einzigartige Hardware-Adresse, die jedem Netzwerkgerät zugewiesen ist.

- Funktionsweise:

- Wenn ein Frame an einem Port des Switches eintrifft, analysiert der Switch den Header dieses Frames, um die Quell- und Ziel-MAC-Adresse zu bestimmen.

- Der Switch verwendet diese Informationen, um zu entscheiden, an welchen Port er den Frame weiterleiten soll.

2. MAC-Adresstabelle

Eines der Hauptmerkmale eines Switches ist die Verwendung einer MAC-Adresstabelle (manchmal auch als CAM-Tabelle – Content Addressable Memory Table bezeichnet). Diese Tabelle wird vom Switch verwendet, um den Datenverkehr effizient zu leiten und zu filtern.

Zweck

Die Hauptfunktion der MAC-Adresstabelle ist es, eine Zuordnung zwischen der MAC-Adresse eines Geräts und dem physischen Port des Switches, an den es angeschlossen ist, zu speichern.

Funktionsweise

Wenn ein Datenpaket (Frame) auf einem Port des Switches ankommt, schaut der Switch in den Frame-Header, um die Quell-MAC-Adresse zu bestimmen. Der Switch aktualisiert seine MAC-Adresstabelle mit dieser MAC-Adresse und dem Port, auf dem

der Frame empfangen wurde. Wenn der Switch einen Frame mit einer Ziel-MAC-Adresse erhält, überprüft er seine MAC-Adresstabelle,

um herauszufinden, auf welchem Port das Gerät mit dieser Adresse angeschlossen ist. Er leitet dann

den Frame nur an diesen speziellen Port weiter.

Unbekannte Adressen

Wenn der Switch einen Frame mit einer Ziel-MAC-Adresse erhält, die nicht in seiner Tabelle steht, sendet er den Frame an alle Ports (außer dem Eingangsport). Dies wird als FFlooding“ bezeichnet. Sobald ein Gerät auf diesen Frame antwortet, kann der Switch die MAC-Adresse und den zugehörigen Port in seine Tabelle aufnehmen.

Alterung und Kapazität

Die Einträge in der MAC-Adresstabelle sind nicht permanent. Sie haben eine Alterungszeit, nach der sie gelöscht werden, wenn keine weiteren Frames von der entsprechenden Adresse empfangen werden. Dies hilft, die Tabelle aktuell zu halten und veraltetete Einträge zu vermeiden. Es gibt auch eine maximale Kapazität für die Tabelle, abhängig von der Hardware und dem Modell des Switches.

Sicherheitsaspekte

In einigen fortgeschrittenen Switches können Administratoren bestimmte MAC-Adressen an bestimmte Ports binden, was als MAC-Adressbindung“ bezeichnet wird. Dies dient als Sicherheitsmaßnahme, um sicherzustellen, dass nur bestimmte Geräte auf bestimmte Ports zugreifen können. In der Praxis ermöglicht die MAC-Adresstabelle eines Switches eine ïntelligente“Weiterleitung von Datenpaketenim Gegensatz zu Hubs, die den Datenverkehr einfach an alle Ports weiterleiten. Diese Effizienz ist einer der Hauptgründe, warum Switches in modernen Netzwerken so weit verbreitet sind.

3. Flooding bei unbekannten Adressen

- Erläuterung: Wenn der Switch einen Frame mit einer Ziel-MAC-Adresse erhält, die nicht in seiner Tabelle aufgeführt ist, nutzt er den Flooding-Mechanismus.

- Funktionsweise:

- Der Switch sendet den Frame an alle seine Ports, mit Ausnahme des Ports, von dem der Frame empfangen wurde. Dieser Prozess wird als „Flooding“ bezeichnet.

- Sobald ein Gerät auf diesen Frame antwortet, kann der Switch die MAC-Adresse und den zugehörigen Port in seine Tabelle aufnehmen.

4. Filtern und Weiterleiten

- Erläuterung: Ein Switch hat zwei Hauptfunktionen – Filtern und Weiterleiten von Frames.

- Funktionsweise:

- Filtern: Der Switch verhindert, dass ein Frame an denselben Port zurückgesendet wird, von dem er empfangen wurde. Dies hilft, den Netzwerkverkehr zu reduzieren und Kollisionen zu vermeiden.

- Weiterleiten: Basierend auf der MAC-Adresstabelle leitet der Switch Frames nur an den Port weiter, an dem das Zielgerät angeschlossen ist.

5. Kollisionsdomänen

- Erläuterung: Im Gegensatz zu Hubs, die eine Kollision verursachen können, wenn zwei Geräte gleichzeitig senden, reduzieren Switches Kollisionen, indem sie jedem Port eine separate Kollisionsdomäne zuweisen.

Switching-Methoden bestimmen, wie ein Switch die Ethernet-Frames verarbeitet, die er erhält, und entscheiden, wohin und wann er sie weiterleiten sollte. Es gibt verschiedene Ansätze, um diese Aufgabe zu bewältigen, und jede hat ihre eigenen Vor- und Nachteile. Hier sind die gängigsten Switching-Methoden:

Cut-Through-Switching

Definition:

Bei der Cut-Through-Methode liest der Switch nur bis zur MAC-Zieladresse des eingehenden Frames, bevor er anfängt, den Frame an das gewünschte Ziel weiterzuleiten.

Arbeitsweise:

- Sobald der Switch die Ziel-MAC-Adresse des Frames erkannt hat (normalerweise innerhalb der ersten 6 Bytes des Frames), beginnt er mit dem Weiterleiten.

- Dies bedeutet, dass der Switch nicht darauf wartet, dass der gesamte Frame vollständig empfangen wurde, bevor er mit dem Weiterleiten beginnt.

Vorteile:

- Schnelle Weiterleitung: Da der Switch nicht den gesamten Frame überprüft, kann er Daten mit minimalem Delay weiterleiten.

Nachteile:

- Fehleranfällig: Da der Switch nicht den gesamten Frame überprüft, können fehlerhafte Frames weitergeleitet werden, was zu Netzwerkproblemen führen kann.

Store-and-Forward-Switching

Definition:

Bei der Store-and-Forward-Methode speichert der Switch den gesamten Frame in einem internen Puffer, überprüft die CRC-Prüfsumme (um festzustellen, ob der Frame fehlerfrei ist) und leitet ihn dann an das gewünschte Ziel weiter.

Arbeitsweise:

- Der Switch wartet, bis der gesamte Frame empfangen wurde.

- Die Fehlerüberprüfung (normalerweise mittels CRC) wird durchgeführt.

- Wenn der Frame fehlerfrei ist, leitet der Switch ihn weiter. Fehlerhafte Frames werden verworfen.

Vorteile:

- Hohe Datenintegrität: Durch das Überprüfen des gesamten Frames werden fehlerhafte Frames erkannt und nicht weitergeleitet.

Nachteile:

- Höhere Latenz: Das Speichern und Überprüfen des gesamten Frames führt zu einer Verzögerung bei der Datenweiterleitung.

Fragment-Free Switching

Definition:

Fragment-Free Switching ist ein Kompromiss zwischen Cut-Through und Store-and-Forward. Dabei liest der Switch die ersten 64 Bytes eines Frames, bevor er mit dem Weiterleiten beginnt.

Arbeitsweise:

- Der Grund für die 64-Byte-Grenze ist, dass die meisten Fehler in Ethernet-Frames innerhalb der ersten 64 Bytes auftreten.

- Der Switch wartet nicht auf den gesamten Frame, aber er liest genug, um viele gängige Fehler zu erkennen.

Vorteile:

- Mittlere Latenz: Schneller als Store-and-Forward, aber mit besserer Fehlererkennung als Cut-Through.

Nachteile:

- Nicht so robust wie Store-and-Forward: Es kann immer noch vorkommen, dass fehlerhafte Frames durchgelassen werden, auch wenn die Wahrscheinlichkeit geringer ist als bei Cut-Through.

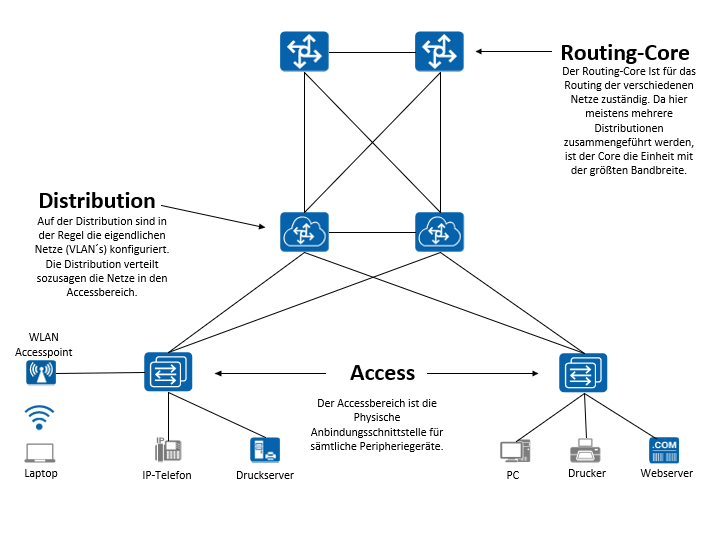

Netzwerkdesign Switches spielen eine entscheidende Rolle im Netzwerkdesign, insbesondere in größeren und komplexeren Netzwerkstrukturen wie Unternehmensnetzwerken. Eine häufig verwendete Methode zur Strukturierung dieser Netzwerke ist das hierarchische Netzwerkdesign, das in drei Hauptebenen unterteilt ist: Core, Distribution und Access. Jede dieser Ebenen hat spezifische Funktionen und Rollen.

1. Core, Distribution und Access Layer

Core Layer (Kernebene):

- Funktion: Das Hauptziel des Core Layers ist es, eine schnelle, zuverlässige und redundante Datenübertragung zwischen den Distribution Switches zu gewährleisten.

- Eigenschaften:

- Hochverfügbar und redundant.

- Minimale Latenz durch schnelle Weiterleitung.

- Keine Paketfilterung oder Dienste, die den Durchsatz verlangsamen könnten.

Distribution Layer (Verteilerebene):

- Funktion: Dieser Layer dient als Bindeglied zwischen dem Access Layer und dem Core Layer. Er bietet Routing, Filtering und WAN-Zugriff und definiert, wie Pakete zum Core-Netzwerk gelangen.

- Eigenschaften:

- Routing zwischen VLANs und Subnetzen.

- Sicherheits- und Filterrichtlinien (z. B. Access Control Lists).

- Quality of Service (QoS) und Address Aggregation.

Access Layer (Zugriffsebene):

- Funktion: Der Access Layer ist der Einstiegspunkt für Endgeräte wie Computer, Drucker und Telefone ins Netzwerk. Er bestimmt, wie Geräte auf die Verteilungsschichten zugreifen.

- Eigenschaften:

- Port-Sicherheit und VLAN-Konfiguration.

- Direkte Verbindung zu Endbenutzergeräten.

- Power over Ethernet (PoE) für Geräte wie Telefone oder Überwachungskameras.

2. Redundanz und Failover-Strategien:

Redundanz und Failover sind Schlüsselkonzepte in Netzwerkdesigns, um hohe Verfügbarkeit und Zuverlässigkeit zu gewährleisten.

Redundanz:

- Zweck: Durch Bereitstellen von Backup-Komponenten oder -Pfaden wird sichergestellt, dass das Netzwerk auch bei einem Ausfall einer Komponente weiterhin funktioniert.

- Implementierung: In der Regel durch die Verwendung von mehreren physischen Verbindungen zwischen Switches, Routern oder anderen Netzwerkkomponenten. Beispielsweise können zwei Core-Switches miteinander verbunden sein, um sicherzustellen, dass bei Ausfall eines Switches der Datenverkehr über den anderen Switch weitergeleitet wird.

Failover-Strategien:

- Zweck: Wenn ein Hauptpfad oder eine Hauptkomponente ausfällt, leitet das Failover den Datenverkehr automatisch über einen Backup-Pfad oder eine Backup-Komponente weiter.

- Implementierung: Es gibt verschiedene Techniken und Protokolle, um Failover zu ermöglichen. Beispiele sind:

- Spanning Tree Protocol (STP): Verhindert Schleifen in Netzwerken und ermöglicht redundante Pfade.

- Hot Standby Router Protocol (HSRP): Cisco-Protokoll, das es ermöglicht, zwei oder mehr Router als Backup füreinander zu konfigurieren.

Durch die richtige Kombination von Switches und Netzwerkdesign-Konzepten, einschließlich der hierarchischen Struktur und Redundanz, kann ein leistungsstarkes, zuverlässiges und skalierbares Netzwerk erstellt werden, das den Anforderungen großer Unternehmen gerecht wird.

[…] Einführung Layer 2 Switch […]